在數字化浪潮席卷全球的今天,互聯網不僅重塑了商業生態,也對企業的營銷管理模式提出了全新挑戰與機遇。傳統營銷咨詢框架亟待升級,以適應快速迭代的市場環境、多元化的用戶觸點與數據驅動的決策需求。專業的互聯網企業營銷管理咨詢,旨在幫助企業構建敏捷、高效且可持續的營銷增長體系。以下十大策略,構成了當代營銷管理咨詢的核心方法論。

一、 數據驅動決策體系構建

摒棄“經驗主義”,建立以用戶行為數據、市場趨勢數據、營銷活動數據為核心的決策模型。咨詢核心在于幫助企業搭建數據采集、清洗、分析與可視化平臺,將數據洞察深度融入產品開發、用戶運營、渠道優化與預算分配等全鏈路,實現營銷活動的可衡量、可優化與可預測。

二、 用戶全景畫像與精細化運營

在去中心化的互聯網環境中,理解用戶是關鍵。咨詢需指導企業利用多源數據(社交、交易、瀏覽等)構建動態、立體的用戶畫像,并基于細分人群(如生命周期階段、興趣偏好、價值分層)設計個性化的觸達、溝通與轉化路徑,實現從流量運營到用戶資產運營的轉變。

三、 全渠道整合與協同營銷

消費者的旅程跨越線上線下多個觸點。咨詢應幫助企業打破渠道壁壘,規劃線上(社交媒體、內容平臺、電商、搜索等)與線下(實體門店、活動等)的無縫銜接體驗。制定統一的品牌信息、促銷策略與數據回流機制,實現渠道間的高效協同與互相增益。

四、 內容戰略與品牌敘事重塑

內容是與用戶建立深度連接的核心載體。咨詢需協助企業制定系統性的內容戰略,包括品牌故事構建、內容矩陣規劃(圖文、視頻、直播等)、分發渠道選擇及效果評估。目標是創造有價值、可傳播的內容,持續強化品牌認知與情感認同。

五、 營銷技術棧(MarTech)規劃與落地

營銷自動化、CRM、CDP、AI工具等MarTech是提升效率的引擎。咨詢需要評估企業現狀,規劃與之匹配的技術棧藍圖,并指導選型、實施與集成,確保技術真正賦能業務,避免陷入“工具孤島”。

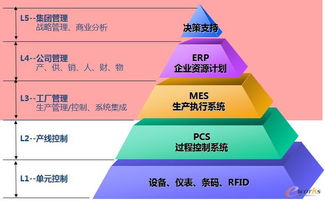

六、 敏捷營銷組織與流程再造

面對快速變化的市場,傳統的金字塔式營銷組織反應遲緩。咨詢應推動企業向以項目或用戶旅程為中心的敏捷型組織轉型,建立小步快跑、快速試錯、持續迭代的工作流程與文化,提升團隊應對不確定性的能力。

七、 增長黑客式實驗機制建立

將“增長黑客”的思維體系化。咨詢需幫助企業建立低成本、快速驗證的增長實驗文化,設計從假設生成、最小化實驗(如A/B測試)、數據分析到規模化推廣的完整閉環流程,系統性地尋找增長突破口。

八、 社交媒體與口碑管理策略

社交媒體是品牌輿論的主陣地。咨詢需制定全面的社媒策略,包括平臺選擇、KOL/KOC合作矩陣、用戶互動機制以及危機預警與應對預案。將用戶從被動接受者轉化為主動傳播者,放大品牌聲量。

九、 效果營銷與品牌建設的平衡藝術

在追求即時ROI的不能忽視長期品牌資產積累。咨詢應幫助企業科學設定長短期營銷目標,合理分配預算,設計既能驅動即時轉化又能提升品牌溢價的整合營銷戰役,實現“品效協同”。

十、 營銷投資回報(ROMI)與價值評估體系

證明營銷的價值至關重要。咨詢需超越簡單的點擊率、轉化率,幫助企業建立涵蓋品牌健康度、用戶生命周期價值(LTV)、客戶獲取成本(CAC)及綜合投資回報率的多元化評估體系,將營銷貢獻與商業成果緊密掛鉤,贏得管理層持續支持。

****

上述十大策略并非孤立存在,而是相互關聯、互為支撐的系統工程。優秀的互聯網營銷管理咨詢,本質上是結合企業特定發展階段、資源稟賦與市場格局,對這些策略進行優先級排序、定制化設計與有機整合的過程。其最終目標,是助力企業在充滿變數的數字商業世界中,構建起兼具韌性、智能與增長潛力的核心營銷競爭力。