在當今瞬息萬變、競爭激烈的商業環境中,企業尋求持續增長與穩健運營的挑戰日益加劇。上海靜初企業管理咨詢有限公司,作為一家植根于國際化大都市的專業咨詢機構,正以其深厚的行業洞察、定制化的解決方案和務實的服務理念,成為眾多企業轉型升級、突破瓶頸的可靠伙伴。

一、專業定位與核心優勢

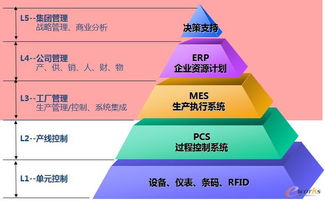

上海靜初企業管理咨詢專注于為企業提供全方位、高價值的管理咨詢服務。其核心優勢在于將國際先進的管理理論與實踐同中國本土的市場環境、企業文化深度融合。咨詢團隊通常由具備豐富實戰經驗的行業專家、資深管理顧問及戰略分析師組成,能夠精準診斷企業運營中的痛點,涵蓋戰略規劃、組織效能提升、人力資源優化、流程再造、市場營銷策略及數字化轉型等多個關鍵領域。

二、量身定制的解決方案

區別于模板化的咨詢服務,靜初咨詢秉承“一案一策”的原則。咨詢流程始于深入的企業診斷,通過詳盡的訪談、數據分析和市場調研,全面了解客戶的獨特狀況、資源稟賦與發展愿景。在此基礎上,團隊會協同客戶共同制定切實可行的實施方案,并提供持續的輔導與支持,確保咨詢成果能夠有效落地,轉化為實實在在的績效改善與競爭力提升。

三、服務價值體現

- 戰略清晰化:幫助企業厘清發展方向,制定兼具前瞻性與可操作性的中長期戰略,在復雜市場中找準定位。

- 運營高效化:通過流程優化與組織設計,降低內部損耗,提升運營效率與協同能力。

- 人才資本化:構建科學的人力資源體系,包括薪酬績效、人才發展與梯隊建設,激發組織活力。

- 風險可控化:完善公司治理與內控體系,提升企業應對各類經營與合規風險的能力。

- 增長持續化:借助市場洞察與創新策略,助力企業開拓新市場、開發新產品,實現可持續增長。

四、面向共筑藍圖

隨著數字經濟時代的全面到來,上海靜初企業管理咨詢亦積極拓展在數字化戰略、智能化運營等前沿領域的咨詢服務能力。其目標不僅是解決企業當前的問題,更是通過知識轉移與能力共建,賦能企業管理團隊,培育內生成長動力,從而引領企業在變革浪潮中行穩致遠。

對于任何志在提升管理水平、追求卓越績效的企業而言,選擇像上海靜初這樣兼具專業深度與務實精神的管理咨詢伙伴,無疑是為自身的未來發展注入了一股強大的智識與戰略推力。